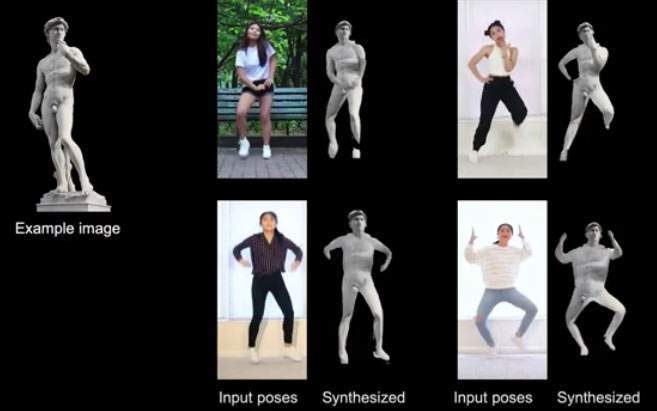

如果您在参观佛罗伦萨的阿卡德 米亚 美术馆(Accademia Gallery)时曾想过,如果米开朗基罗的《大卫》随着哈达威的《爱是什么》(或任何舞曲)的音符翩翩起舞,它会有什么样的表现,那么现在我们可以说,您的好奇心已经得到了满足。英伟达公司(NVIDIA Corporation,一家生产著名图形处理器、显卡和计算机多媒体产品的美国公司)的一组研究人员为米开朗基罗的杰作制作了动画,让它翩翩起舞。

事实上,这六位研究人员并不是没有更好的事情可做:他们跳舞的《大卫》被用来测试一个视频到视频合成程序,该程序将其他有血有肉的人类的模仿能力应用到人类和物体(就《大卫》而言,是雕像)上。研究人员在论文摘要中写道:“视频到视频(vid2vid)合成”,"旨在将语义视频输入(如人类动作视频或分割遮罩)转换为逼真的视频。研究人员解释说,不仅如此,这项研究还旨在克服vid2vid 合成的两个严重局限性,即此类操作需要大量数据才能保证得到可接受的结果,以及 vid2vid 模型的泛化能力有限(即 vid2vid 模型只有在应用于摆出模型姿势的人时才能有效:换句话说,vid2vid 模型不能用于创建其他人的视频)。

NVIDIA 公司研究人员的工作是学习如何合成某些输入,然后将其传递给那些 “摆好姿势 ”充当节目模特的人以外的其他对象:在舞池中舞动的大卫就是这项制作逼真视频的重要研究成果。同样的方法也适用于参加测试的人的照片:给定两个输入(一段跳舞人物的视频和将被制作成动画的人物照片),就可以制作出照片中人物的逼真视频,他们发现自己(我们可以说是不顾自己)在迪斯科音乐中翩翩起舞。该工作室和测试动画视频可在此链接中找到。

总之,这些研究试图发展创建逼真图像和视频的应用软件的技术水平,然而,这些应用软件却让人头疼不已,特别是如果我们考虑到隐私和深度伪造问题,即根据真人照片制作的逼真(但却是伪造的)图像(例如,现在已经有了一些应用软件,只需向他们提供一张照片,就能真正 “脱掉 ”一个人的衣服)。像 "大卫"跳舞这样的视频可能会成为下一个发展方向(想想也是,有点令人不安)。

|

| 美国研究人员让米开朗基罗的大卫随节拍起舞,以研究逼真视频的制作方法 |

免责声明:本篇意大利语原文的中文翻译由自动工具生成。 我们承诺会对所有文章进行审核,但无法保证完全避免因软件造成的翻译误差。 您可以点击 ITA 按钮查看原文。如发现任何错误,请联系我们。